Por que você não deve trocar o médico por um chatbot de IA?

Pesquisas indicam que a precisão das ferramentas de IA que analisam informações de saúde cai drasticamente dependendo da interação humana

O uso de sistemas de inteligência artificial, como ChatGPT, Gemini e Grok, para dúvidas relacionadas à saúde vem se tornando uma opção frequente entre pessoas que procuram respostas rápidas diante da dificuldade de conseguir atendimento com clínicos gerais. Porém, pesquisas recentes levantam um alerta importante: as respostas fornecidas podem mudar de forma significativa dependendo da forma como o usuário formula a pergunta e do modelo de IA utilizado na consulta.

Um exemplo real desse cenário é o de Abi, uma moradora de Manchester, na Inglaterra, que utiliza chatbots há um ano. Se por um lado a ferramenta foi assertiva ao sugerir que ela procurasse um farmacêutico para tratar uma infecção urinária, por outro, a IA causou pânico desnecessário ao afirmar que ela havia “perfurado um órgão” após uma queda, diagnóstico que se provou totalmente errado após três horas de espera no pronto-atendimento.

O Laboratório de Raciocínio com Máquinas da Universidade de Oxford investigou essa discrepância. Em ambientes controlados, onde os chatbots recebiam quadros clínicos completos e técnicos, a precisão foi de impressionantes 95%. Contudo, quando a interação envolveu pessoas reais simulando consultas, a precisão despencou para 35%.

O pesquisador Adam Mahdi explica que o problema reside na forma como nos comunicamos: seres humanos tendem a compartilhar informações de forma gradual, esquecem detalhes ou se distraem. Essas nuances “tiram a IA dos trilhos”, transformando casos graves, como hemorragias cerebrais, em recomendações inadequadas de repouso, dependendo de como os sintomas são descritos.

Por que não podemos confiar na IA?

Diferentemente de uma pesquisa convencional no Google, na qual o usuário recebe uma lista de fontes e pode avaliar a credibilidade de sites oficiais de saúde, os chatbots entregam uma resposta única, adaptada à conversa. Para a médica Margaret McCartney, essa dinâmica pode criar uma sensação de “vínculo pessoal” com a ferramenta, o que aumenta o risco de o paciente aceitar a informação sem questionamento crítico.

O diretor médico da Inglaterra, Chris Whitty, também faz um alerta sobre esse tipo de uso:

´´Estamos em um ponto delicado porque as respostas não são suficientemente boas e, muitas vezes, são apresentadas com convicção e erradas´´

Chris Whitty, diretor médico da Inglaterra.

Além das falhas em diagnósticos, existe também o risco de disseminação de informações incorretas de forma intencional ou induzida. Uma pesquisa do Instituto Lundquist, na Califórnia, avaliou modelos como Gemini, DeepSeek, Meta AI, ChatGPT e Grok a partir de perguntas com viés. Em um dos cenários, ao ser interrogada sobre tratamentos alternativos para o câncer, uma das inteligências artificiais indicou a naturopatia, em vez de explicar que não há comprovação científica de eficácia para esse tipo de cura.

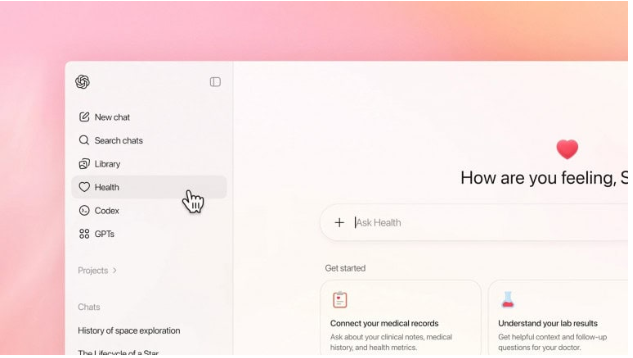

As empresas responsáveis pelo desenvolvimento desses sistemas, como a OpenAI, afirmam que mantêm trabalho contínuo com especialistas da área da saúde para aprimorar a segurança e a qualidade das respostas. Ainda assim, reforçam que ferramentas como o ChatGPT devem ser utilizadas apenas como apoio educativo e informativo, sem substituir a avaliação de profissionais de saúde.

A recomendação final de especialistas e de usuários com experiência, como a própria Abi, é semelhante: é preciso encarar as respostas da IA com grande cautela. No campo médico, esses sistemas funcionam como assistentes que identificam padrões de linguagem, e não como fontes de autoridade clínica capazes de assegurar precisão absoluta.

Fonte: Olhar Digital

Previous Post

Previous Post Next Post

Next Post